一、前言

大概是一个月前就开始做淘宝的爬虫了,从最开始的用selenium用户配置到selenium模拟登录,再到这次的post请求模拟登录。一共是三篇博客,记录了我爬取淘宝网的经历。期间也有朋友向我提出了不少问题,比如滑块失败,微博登录失败等,可以说用selenium模拟登录这方面,坑特别多,直接加载用户配置又很笨重,效率低下。所以这次尝试构造post请求表单,模拟登录。

很多人学习python,不知道从何学起。

很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手。

很多已经做案例的人,却不知道如何去学习更加高深的知识。

那么针对这三类人,我给大家提供一个好的学习平台,免费领取视频教程,电子书籍,以及课程的源代码!

QQ群:101677771

往期链接:

https://blog.csdn.net/pineapple_C/article/details/107461989

https://blog.csdn.net/pineapple_C/article/details/107641799

github源码链接:

https://github.com/Pineapple666/TaobaoSpider/tree/master/Taobao_face

本文篇幅较长,建议先看代码,有疑惑的再来看。

二、模拟登录

1)用浏览器走一遍登录过程

先把淘宝网的cookies全部清除,然后访问淘宝:https://www.taobao.com,这时候是不需要登录的。

在搜索框搜索iphone,立即跳出了登录页面,它的url是:https://login.taobao.com/member/login.jhtml?redirectURL=http%3A%2F%2Fs.taobao.com%2Fsearch%3Fq%3Diphone%26imgfile%3D%26commend%3Dall%26ssid%3Ds5-e%26search_type%3Ditem%26sourceId%3Dtb.index%26spm%3Da21bo.2017.201856-taobao-item.1%26ie%3Dutf8%26initiative_id%3Dtbindexz_20170306&uuid=f6dd176ff336683f5d47fc1cb16504af

很长很长,但标红的这部分url很重要,redirectURL是重定向url,登录后会跳转到这个url,当然这个是经过url编码的。

2)用抓包工具分析登录过程

既然可行,那么接着再来一次,这次看看这个过程都发起了哪些请求,提交了哪些数据。(别忘记清除cookies)

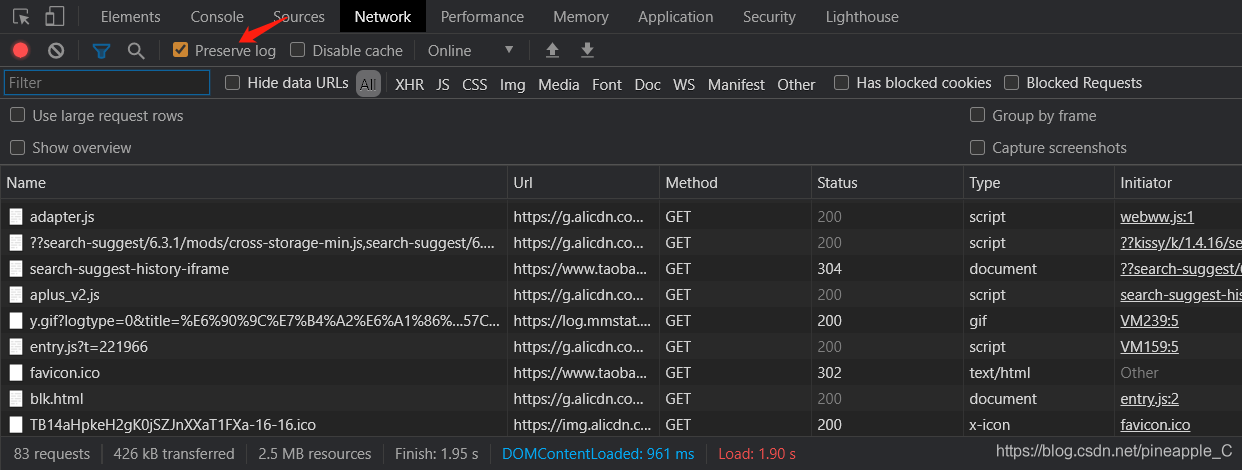

可以使用浏览器开发者模式也可以使用抓包工具Fidder,使用浏览器的话要打开Preserve log

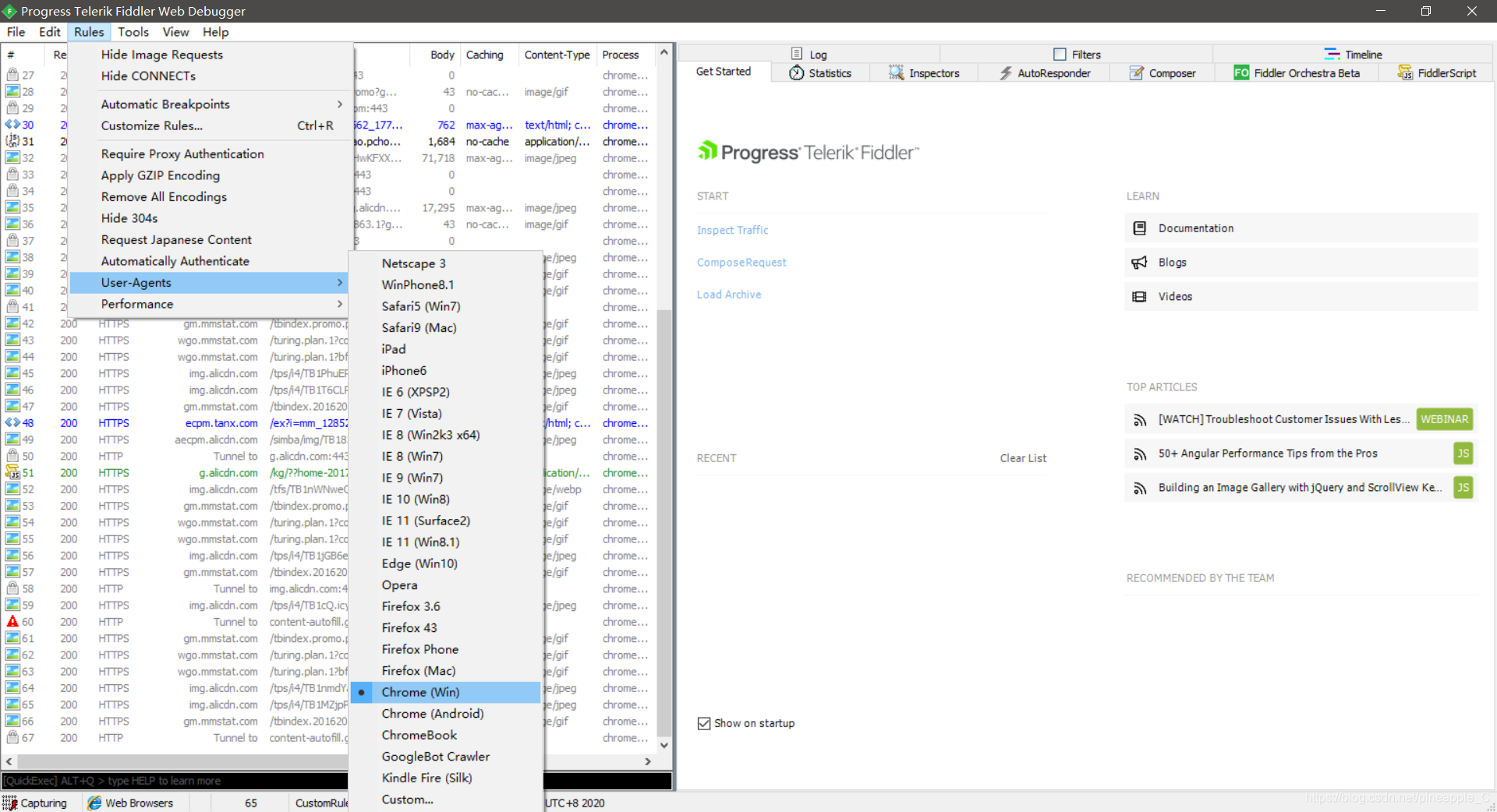

设置抓取的User-Agents为Chrome

点击登录。查看请求记录。

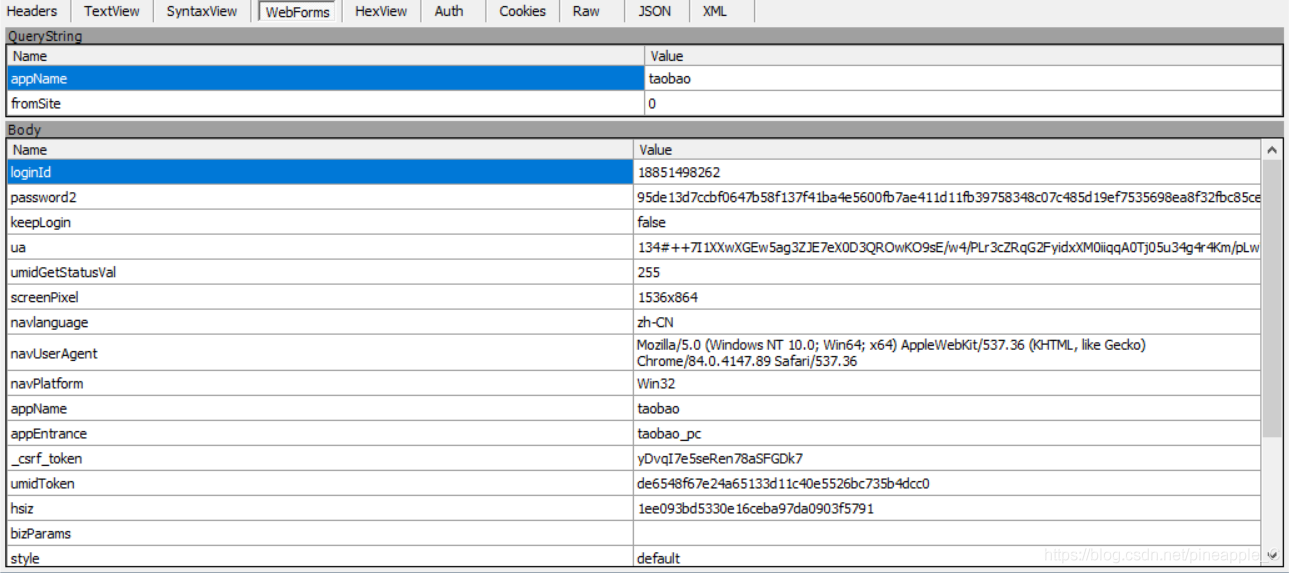

第一个是最开始访问的登录页面,一个普通的get请求,第二个就不同了,它是一个post请求,其中表单包含了大量的数据信息

1、loginId一眼就可以看出是账号,ua猜测为一种加密后的用户标识,password2猜测为加密后的密码。这三条信息可以当作固定值反复使用

2、_csrf_token, umidToken, hsiz隐藏在登录页面里

3)代码实战

文件名为login.py,类名为Login

ua, loginId, password2这三个是用户信息,传递这三个参数以初始化Login类。PRODUCT是一个全局变量,代表着商品名,在setting.py里可以设置这个变量。如果商品名带有中文,则需要用urllib.parse.quote()进行url编码。

logged函数

为了方便登录,每次登录成功后都会自动保存cookies,所以在登录之前都先要判断是否存在cookies,cookies是否正确等问题。如果上述条件都不成立的话,则重新登录,重新保存cookies。模拟登录最重要的就是执行post请求,而执行post请求就要构造好一个正确的post字典,对于_csrf_token, umidToken, hsiz这三条数据,可以去登录页面提取

这个提取过程主要依靠这两个函数:

使用Python的@property装饰器,访问内部属性。它相当于又创造了一个和函数名相同的一个属性。调用此函数即调用此属性,有点像Java里的get方法。由于_csrf_token, umidToken, hsiz这三个字段都有一个共同点,都可以通过上面的正则表达式匹配到,所以可以归结为一个函数,不用写三个函数。

表单构造完后,发起post请求,SESSION是一个全局会话,登录和爬取都是一个会话,方便处理cookies。

请求没有问题后,调用queue_cookies(),立即保存cookies

之后有一个self.redirect_url,对重定向url的再次赋值,这个主要是检查是否会出现滑块验证。只有在连续多次相同ip登录的时候才会跳转到滑块验证,这时候如果还是访问原先的url,它也会跳转,所以加不加都行。

如果登录成功了,可以输出一下当前的网页标题来验证一下

TitleErrors是个自定义异常,用来捕捉标题错误。出现滑块验证时候的标题为:security-X5这个时候要等待一会才能登录成功

这个抛出异常分为两种情况,如果是加载cookies失败,则重新登录,如果是登录失败,则退出程序,这是在load_cookies()函数内实现的

加载cookies首先要将保存的cookies取出来

根据load_cookies()的返回值判断是否不需要登录。

这就是整个登录的流程,本来很简单的被我这么一说反而变复杂了。再概括一下整个流程吧,首先一上来先加载cookies,如果没有cookies文件,或者加载cookies失败,则再登录一遍并保存cookies,输出当前页面标题,符合条件则登录成功,不符合则失败退出程序。

三、爬取商品列表

借助全局的SESSION来处理cookies,就可以实现连续翻页,访问详情页面的操作。当然详情页面的爬取还有带开发,先爬取商品列表。

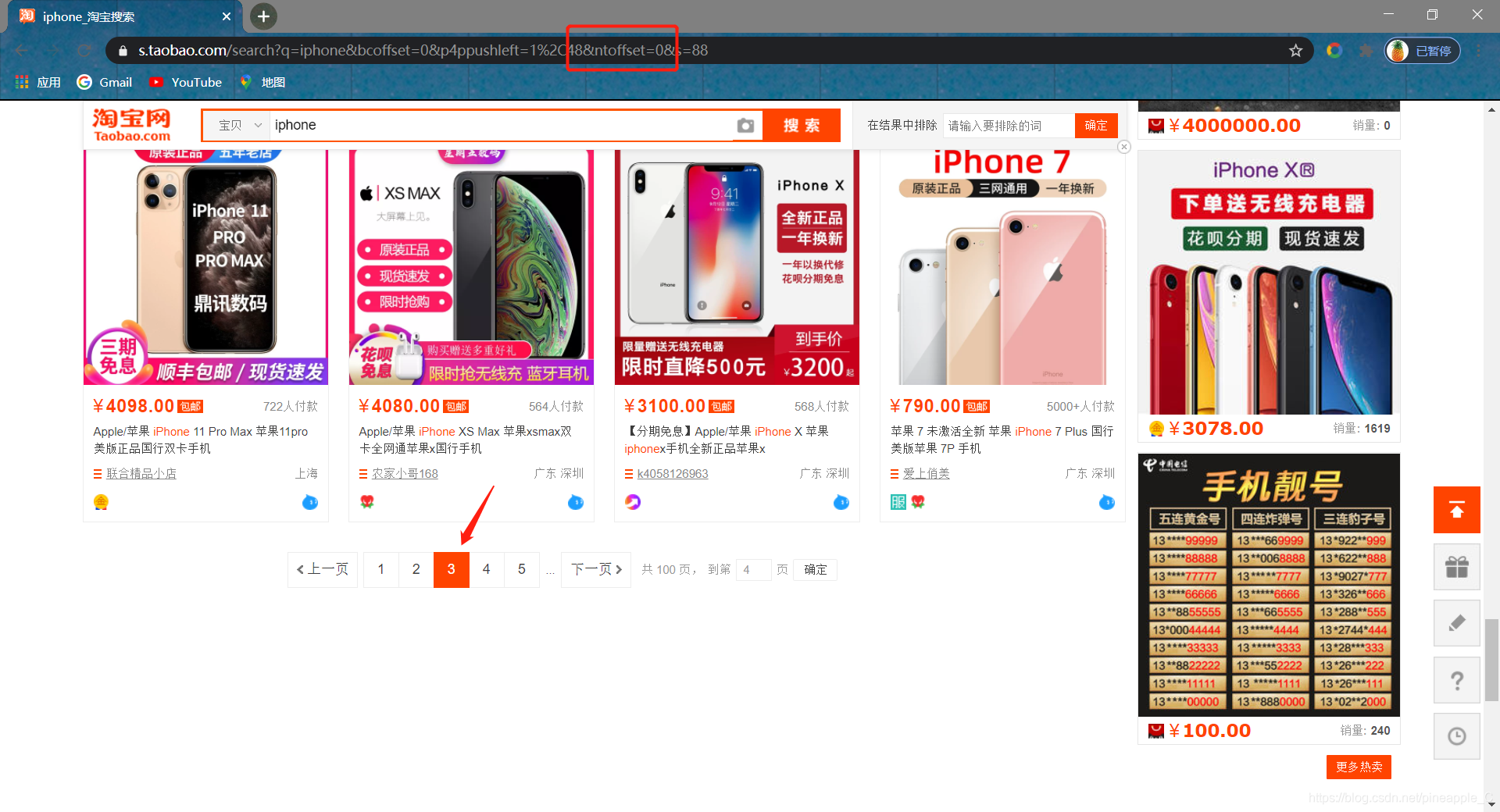

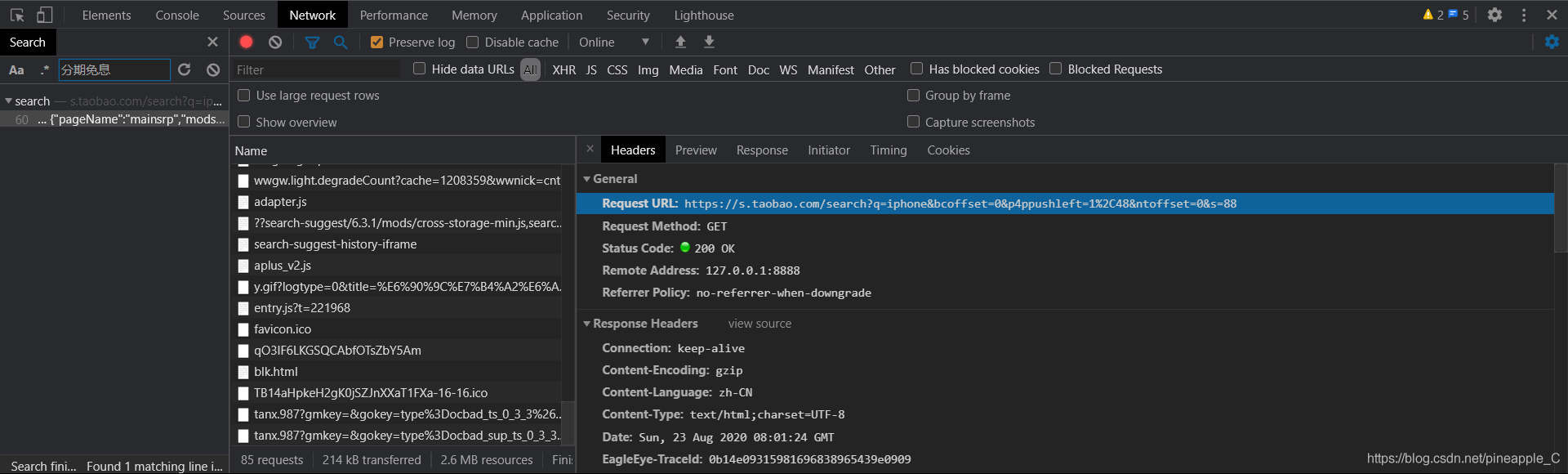

1)分析url

https://s.taobao.com/search?q=iphone&bcoffset=6&p4ppushleft=1%2C48&ntoffset=6&s=0

https://s.taobao.com/search?q=iphone&bcoffset=3&p4ppushleft=1%2C48&ntoffset=3&s=44

https://s.taobao.com/search?q=iphone&bcoffset=0&p4ppushleft=1%2C48&ntoffset=6&s=88

https://s.taobao.com/search?q=iphone&bcoffset=-3&p4ppushleft=1%2C48&ntoffset=-3&s=132

https://s.taobao.com/search?q=iphone&bcoffset=-6&p4ppushleft=1%2C48&ntoffset=-6&s=176

这是前五页的url,虽然参数很多,但也能窥探到其中的规律。

bcoffset和ntoffset判断为偏移量,从6开始逐页递增-3。s判断为已观看的商品数,从0开始逐页递增44

等一下,第三页的两个偏移量不相等啊?先别急,访问归我纳出的url试一下:https://s.taobao.com/search?q=iphone&bcoffset=0&p4ppushleft=1%2C48&ntoffset=0&s=88

PRODUCT前面说过了,是商品名。

因为毕竟这不是一个小项目,淘宝的反爬也是非常厉害,所以按照可以添加代理的方式编写代码,为以后的代理,异步操作做准备。

这其中就有构造一个淘宝请求类,储存请求类,获取代理,设置超时时间,代理异常捕捉等问题。听我一一道来。

2)获取代理

PROXY_POOL_URL是获取代理的url,这个要配合代理池的使用。即使是付费代理,最好也是在代理池走一遍流程,以提高代理的正确率。

3)分析网页代码

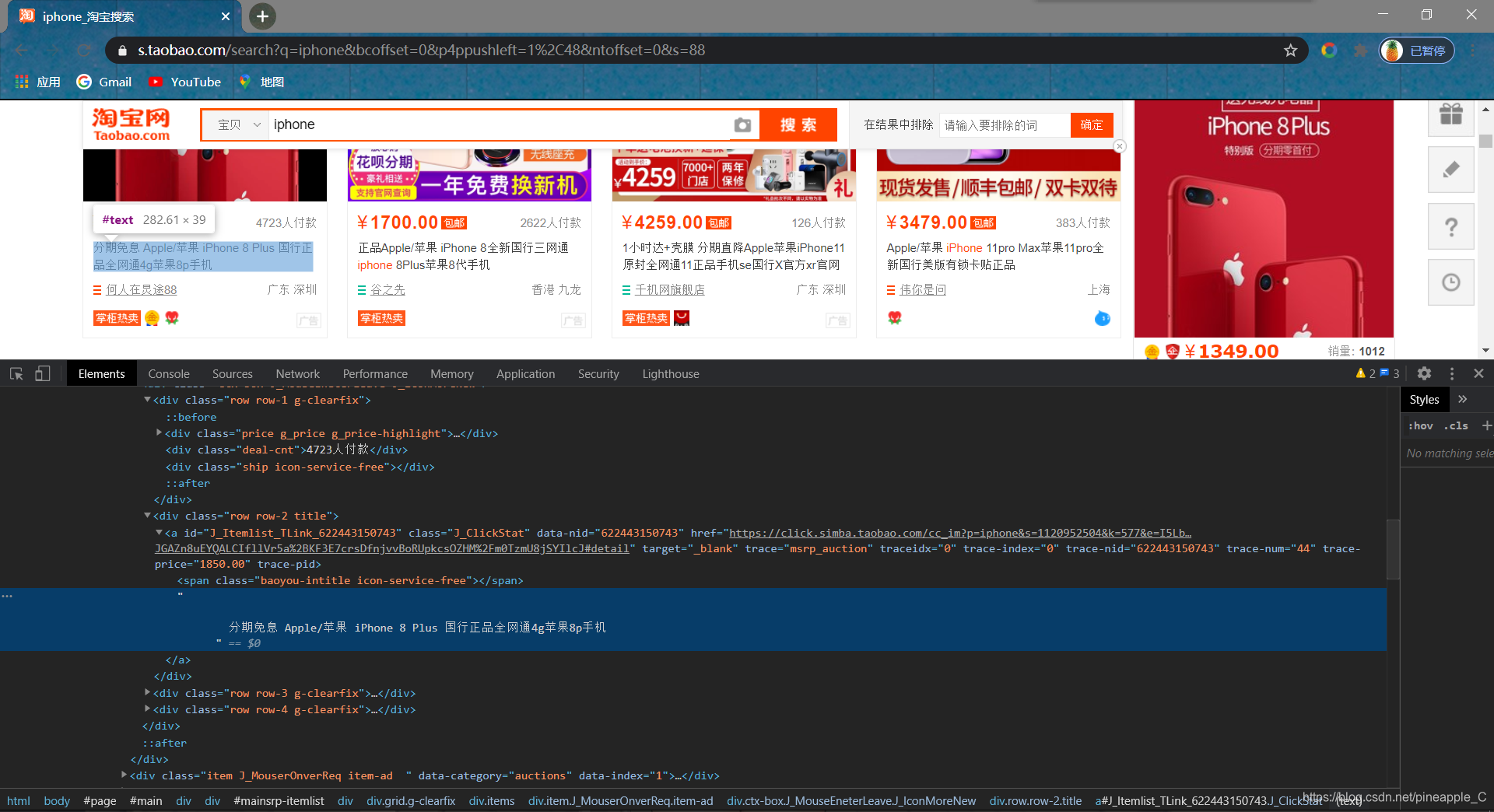

浏览器看到的代码

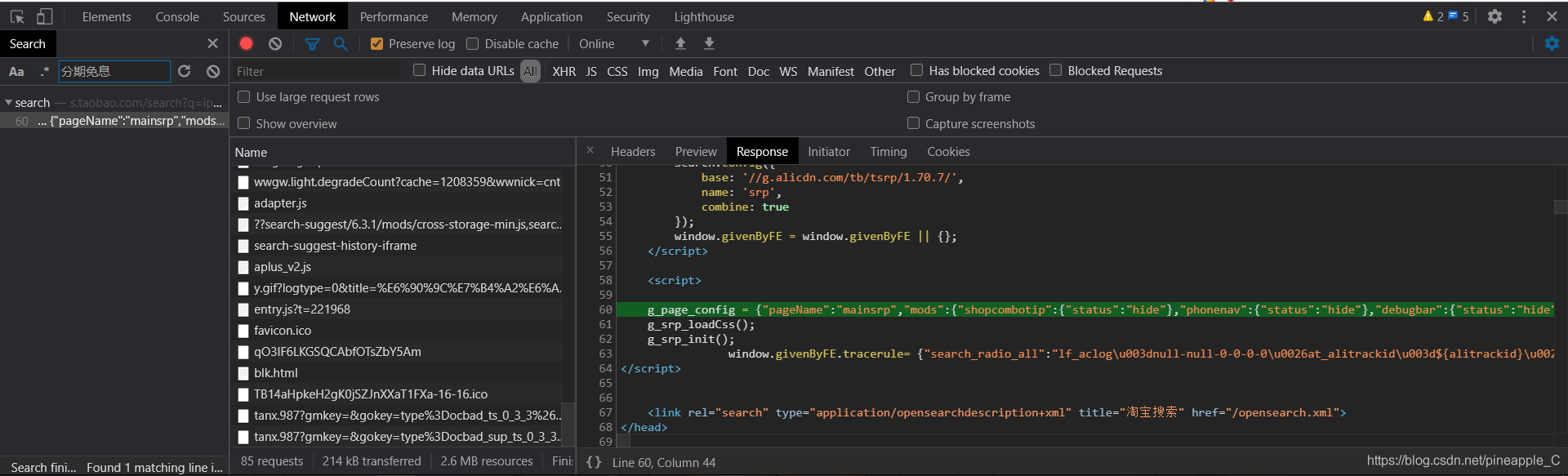

既然在html里找不到,那干脆就搜索吧,点击NetWork,刷新一下页面,搜索任意商品标题

4)解析页面

因为要保存到mysql里面,所以匹配结果的每一组都应该是一个字典,都放在一个列表里。对于这个列表怎么构造,在这里说明一下:

re.findall()返回的结果是一个列表,列表内的每个元素都是一个元组,一个元组就是一个商品的信息(标题,价格,成交人数等等),keys也是一个元组,代表着mysql里的键名,运用dict(zip(keys,value))的方式创建字典,最后外面套上个列表推导式,这个列表就搞定了。

有时候,因为一个商品少了view_sales这个键,导致item_loc的值非常长,直接匹配到下一个商品的item_loc,这种情况是不允许的,所以加上长度限制,过长则直接跳过。

根据以往的套路,有了url,代理,解析函数,基本上就可以完成这次的爬虫了。但这次不同,要做到一个高效稳定的爬虫仅仅考这些是不够的。就好比代理,万一这次的请求失败了怎么办,会不会出现异常,这页的数据就不要了吗?当然是不行的,不到万不得已,绝不放过任何一条有价值的数据。所以要建立一个高稳定的高容错率的机制。

用redis去配合mysql的存储

5)淘宝请求类:

上面构造了一个请求类,目的就是把本次请求的相关参数比如失败次数,超时时间,是否需要代理等整合到一起,统统放到redis数据库内。然后统一调度,若请求失败则再放入redis中,等待下一次的调度。这样就不会丢失数据。

6)存储

存好url,等待后面的调度

7)调度

首先判断是否还有请求类等待调度,有则取出这个请求类,拿出来的这个类只是一空盒子,里面没有任何东西,只有表面的信息(捆绑在一起的参数)。所以要请求这个类里面的url,才能得到响应,盒子里才会有内容。

8)请求

在请求之前先判断是否需要代理,need_proxy这个属性是根据setting.py里的NEED_PROXY设置的。代理这个东西,有可能上一秒测试的时候还是好好的,下一秒就不行了,寿命非常有限。所以还是要有相应异常捕捉机制。

调度函数里的callback就是解析函数parse_detail(),如果这个请求返回的是个False,parse_detail()自然就不能解析出数据,解析不到数据怎么办?

这时候就用到容错函数了

9)错误处理

- 1

在解析的数据出现异常的时候,便会调用这个函数,将失败次数+1,到了最大失败次数MAX_FAIL_TIME时则从redis中彻底删除这个请求,MAX_FAIL_TIME在setting.py中设置。

如果解析数据成功,就直接插入mysql里。

有关redis和mysql的代码,都是些套路问题,记下来就好,需要的时候直接拿出来用,我就不在博客里详细介绍了。

更多详细内容,完整代码见github:https://github.com/Pineapple666/TaobaoSpider/tree/master/Taobao_face

三、结语

今天迈出了第一步,再接再厉!